از طریق منوی جستجو مطلب مورد نظر خود در وبلاگ را به سرعت پیدا کنید

آموزش رابط کاربری گرافیکی Ollama: روش راه اندازی و استفاده از Olama با Open WebUI

سرفصلهای مطلب

به طور پیش فرض، Olama مدل های زبان بزرگ (LLM) را از طریق a اجرا می کند command-line رابط (CLI). با این حال، میتوانید Olama را با Open WebUI – یک ابزار رابط کاربری گرافیکی (GUI) – برای تعامل با این مدلها در یک محیط بصری جفت کنید.

این تنظیمات پیچیده و مستعد خطا را کاهش می دهد command-line ورودیها، آن را برای کاربران غیر فنی و تیمهایی که به روشی مشترک و بصری برای کار با LLM و استقرار برنامههای هوش مصنوعی نیاز دارند، ایدهآل میکند.

در این مقاله، روش راه اندازی Ollama و Open WebUI را به ساده ترین راه – با استفاده از یک الگوی سرور خصوصی مجازی (VPS) از پیش پیکربندی شده، یاد خواهید گرفت. همچنین شما را از طریق داشبورد Open WebUI راهنمایی میکنیم، به شما نشان میدهیم که چگونه خروجیهای مدل را سفارشی کنید، و ویژگیهای همکاری را بررسی میکنیم.

راه اندازی Olama با Open WebUI

ساده ترین راه برای استفاده از Olama با Open WebUI، انتخاب یک است هاستینگer طرح میزبانی LLM. به این ترتیب تمام اجزای لازم – Docker، Ollama، Open WebUI و Llama 3.1 مدل – از پیش پیکربندی شده اند.

مبتنی بر روی سیستم مورد نیاز Olama را توصیه می کنیم KVM 4 طرح، که فراهم می کند چهار vCPU هسته ها، 16 گیگابایت رم و 200 گیگابایت ذخیره سازی NVMe برای 10.49 دلار در ماه. این منابع تضمین می کند که پروژه های شما به خوبی اجرا می شوند.

پس از خرید طرح، میتوانید با وارد کردن آدرس IP VPS خود و سپس به داشبورد Open WebUI دسترسی پیدا کنید. :8080 در مرورگر شما به عنوان مثال:

http://22.222.222.84:8080

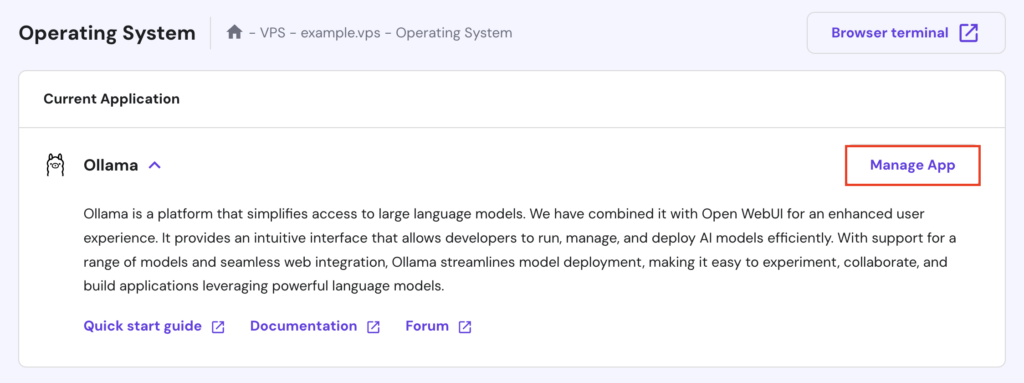

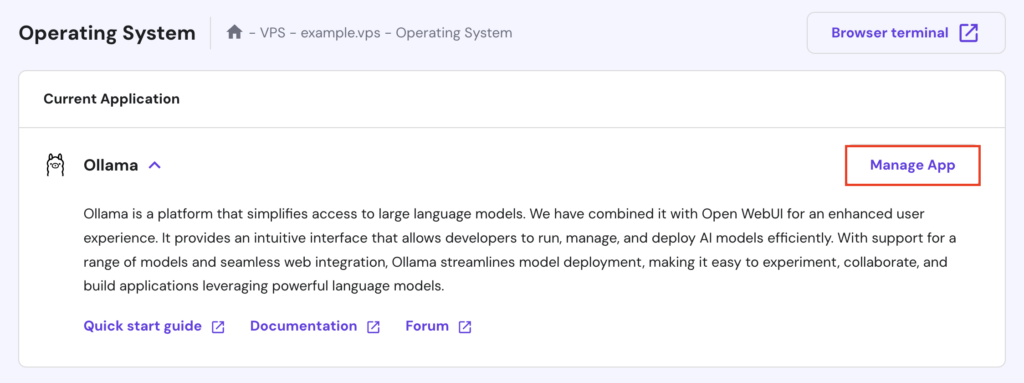

با این حال، اگر از زمان راه اندازی اولیه سیستم عامل خود را تغییر داده اید یا از یک سیستم عامل معمولی استفاده می کنید هاستینگer برنامه VPS، شما همچنان می توانید Olama را به عنوان یک الگو با دنبال کردن مراحل زیر نصب کنید:

- وارد شوید به hPanel و حرکت کنید به VPS → مدیریت.

- از نوار کناری سمت چپ داشبورد VPS، به سیستم عامل و پنل → سیستم عامل.

- در سیستم عامل را تغییر دهید بخش، انتخاب کنید برنامه → اوبونتو 24.04 با اوللاما.

- ضربه بزنید سیستم عامل را تغییر دهید برای شروع نصب

در اطراف صبر کنید 10 دقیقه برای نصب process برای تکمیل. پس از اتمام، به بالا بروید و کلیک کنید مدیریت برنامه برای دسترسی به WebUI باز کنید.

در اولین بازدید خود، از شما خواسته می شود که یک حساب Open WebUI ایجاد کنید. دنبال کنید روی-دستورالعمل ها را روی صفحه نمایش دهید و اعتبار خود را برای دسترسی در آینده ذخیره کنید.

استفاده از Olama با Open WebUI

این بخش به شما کمک میکند تا با ویژگیهای Open WebUI، از پیمایش در داشبورد گرفته تا کار با مدلهای چندوجهی آشنا شوید.

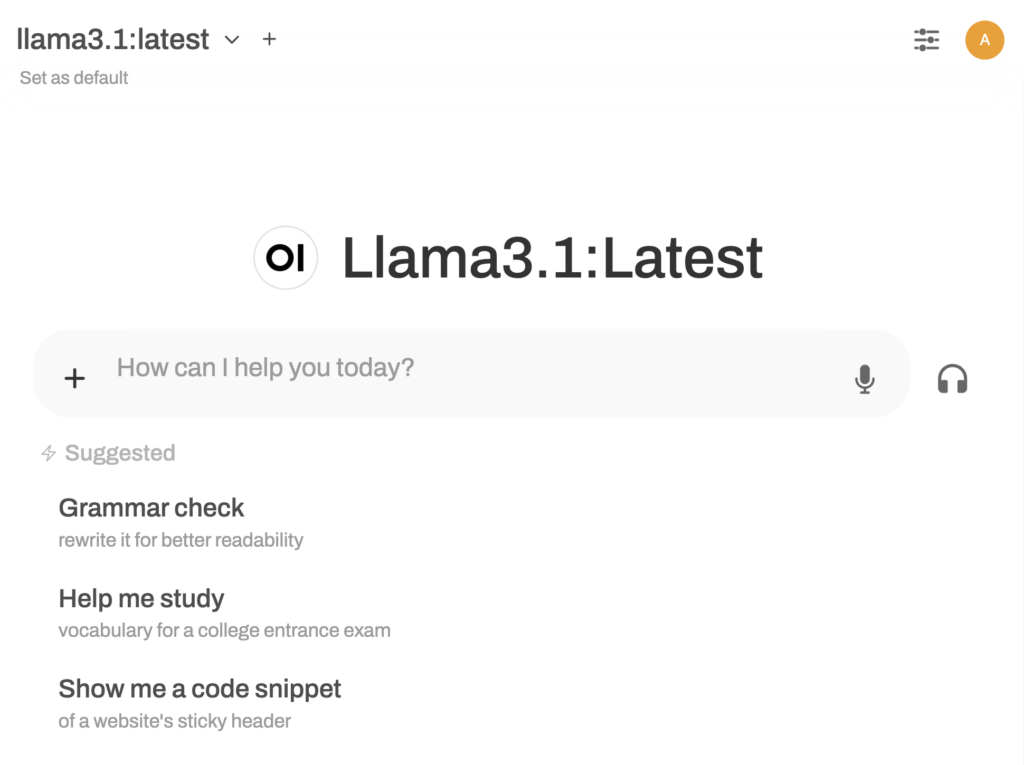

پیمایش در داشبورد

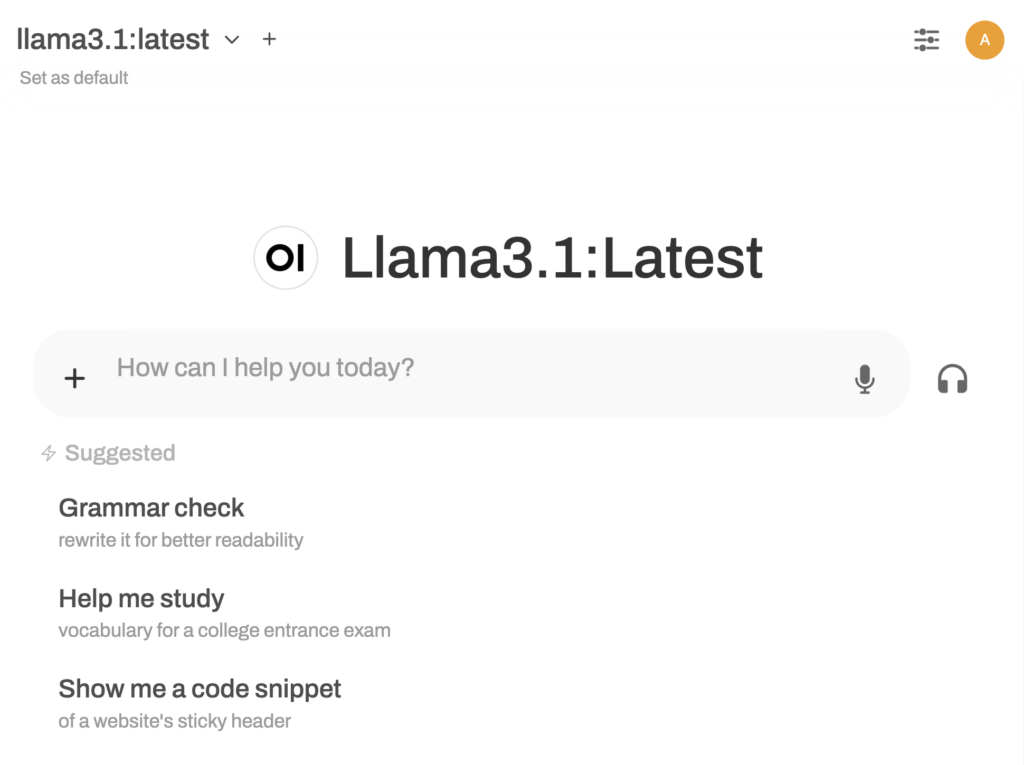

داشبورد Open WebUI یک طرح بصری و مبتدی را ارائه می دهد. اگر با ChatGPT آشنایی دارید، تطبیق با Open WebUI حتی ساده تر خواهد بود، زیرا آنها رابط کاربری مشابهی دارند.

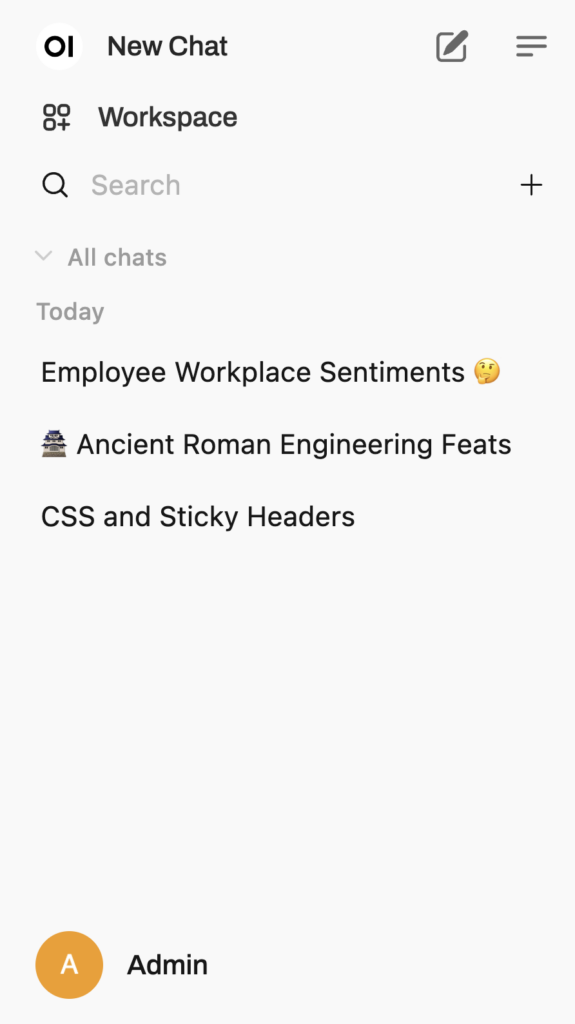

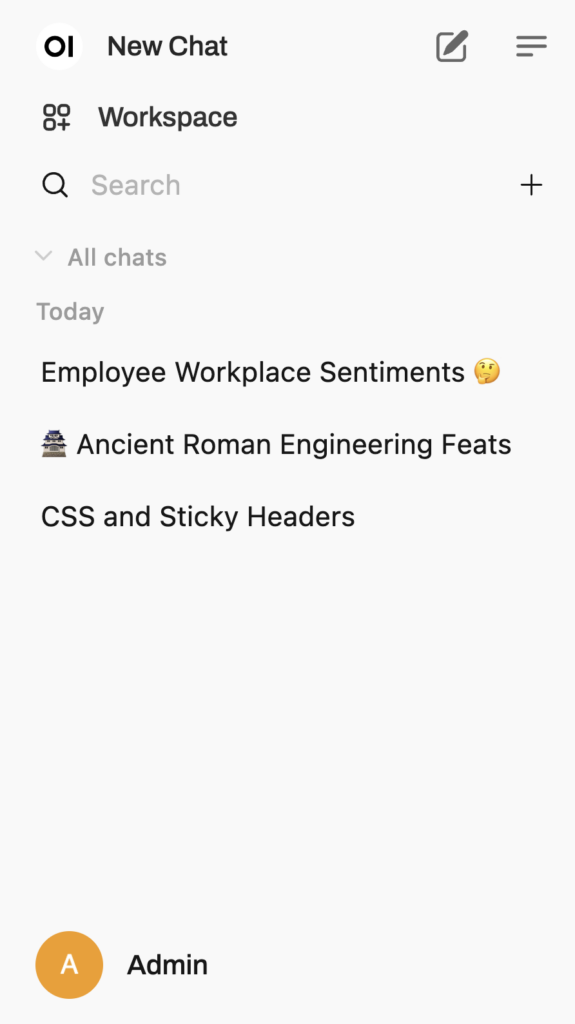

داشبورد به دو بخش اصلی تقسیم می شود:

- پنجره داده. این رابط اصلی چت است که در آن میتوانید با تایپ کردن پیامها، آپلود فایلها یا استفاده از دستورات صوتی با مدل تعامل کنید. در گوشه سمت چپ بالا، میتوانید مدلهایی را انتخاب کنید یا مدلهای دیگری را از کتابخانه اوللاما دانلود کنید. در همین حال، برای تنظیم رفتار مدل، دسترسی به تنظیمات یا باز کردن پنل مدیریت، به گوشه بالا سمت راست بروید.

- نوار کناری سمت چپ. نوار کناری به شما امکان می دهد تا موضوعات جدید را شروع کنید یا تعاملات قبلی را ادامه دهید. در اینجا میتوانید مکالمات را پین، بایگانی، اشتراکگذاری یا حذف کنید. همچنین شامل یک بخش مدیریت فضای کاری است که در آن میتوانید مدلهای Ollama سفارشی ایجاد کنید و آنها را با دانش، اعلانها و عملکردهای خاص آموزش دهید.

انتخاب و اجرای یک مدل

از آنجایی که Olama و Open WebUI را با استفاده از هاستینگer الگو، لاما 3.1 مدل آماده استفاده است با این حال، می توانید مدل های زبان دیگر را از طریق پانل انتخاب مدل در گوشه سمت چپ بالای صفحه داده خود دانلود کنید.

در اینجا، یک مدل را با تایپ نام آن در نوار جستجو اضافه کنید و ضربه بزنید بکشید [model] از Olama.com. اگر مطمئن نیستید که از کدام مدل استفاده کنید، مراجعه کنید کتابخانه مدل اولاما برای توضیحات دقیق و موارد استفاده توصیه شده

![آموزش رابط کاربری گرافیکی Ollama: روش راه اندازی و استفاده از Olama با Open WebUI 9 کشش [model] از گزینه Olama.com در پنل انتخاب مدل Open WebUI](https://rasanegaar.com/blog/wp-content/uploads/2024/12/1735190007_284_آموزش-رابط-کاربری-گرافیکی-Ollama-نحوه-راه-اندازی-و-استفاده.png)

![آموزش رابط کاربری گرافیکی Ollama: روش راه اندازی و استفاده از Olama با Open WebUI 10 کشش [model] از گزینه Olama.com در پنل انتخاب مدل Open WebUI](https://rasanegaar.com/blog/wp-content/uploads/2024/12/1735190007_284_آموزش-رابط-کاربری-گرافیکی-Ollama-نحوه-راه-اندازی-و-استفاده.png)

برخی از گزینه های محبوب عبارتند از میسترال، معروف به کارایی و عملکرد در ترجمه و خلاصه سازی متن و کد لاما، به دلیل قدرت آن در تولید کد و وظایف مربوط به برنامه نویسی مورد علاقه است.

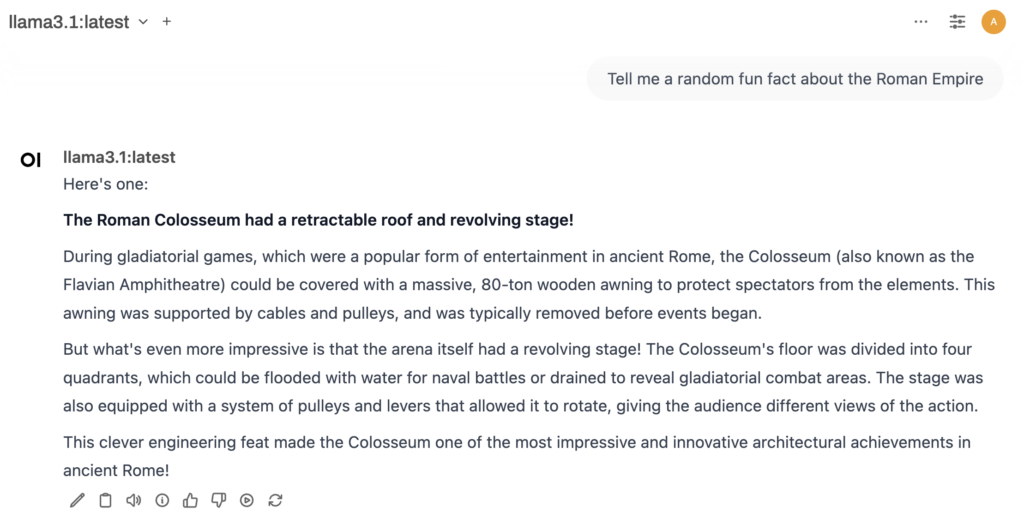

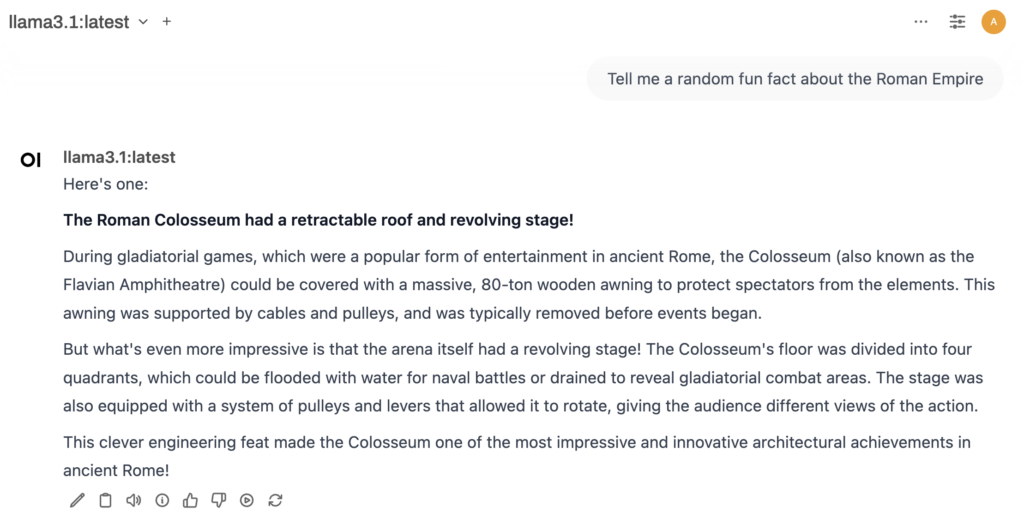

پس از دانلود، یک مکالمه جدید را با کلیک کردن شروع کنید چت جدید. مدل را انتخاب کنید و درخواست خود را تایپ کنید، سپس مدل یک پاسخ ایجاد می کند. مانند ChatGPT، میتوانید خروجیها را کپی کنید، بازخورد بدهید یا پاسخها را در صورتی که انتظارات شما را برآورده نمیکنند، بازسازی کنید.

برخلاف استفاده از اوللاما از طریق command-line رابط (CLI)، ترکیب این ابزار LLM با Open WebUI به شما امکان میدهد مدلها را در اواسط مکالمه تغییر دهید تا خروجیهای مختلف را در یک چت بررسی کنید. به عنوان مثال، می توانید با آن شروع کنید لاما برای یک بحث کلی و سپس تغییر به ویکونا برای پاسخ تخصصی تر روی همین موضوع

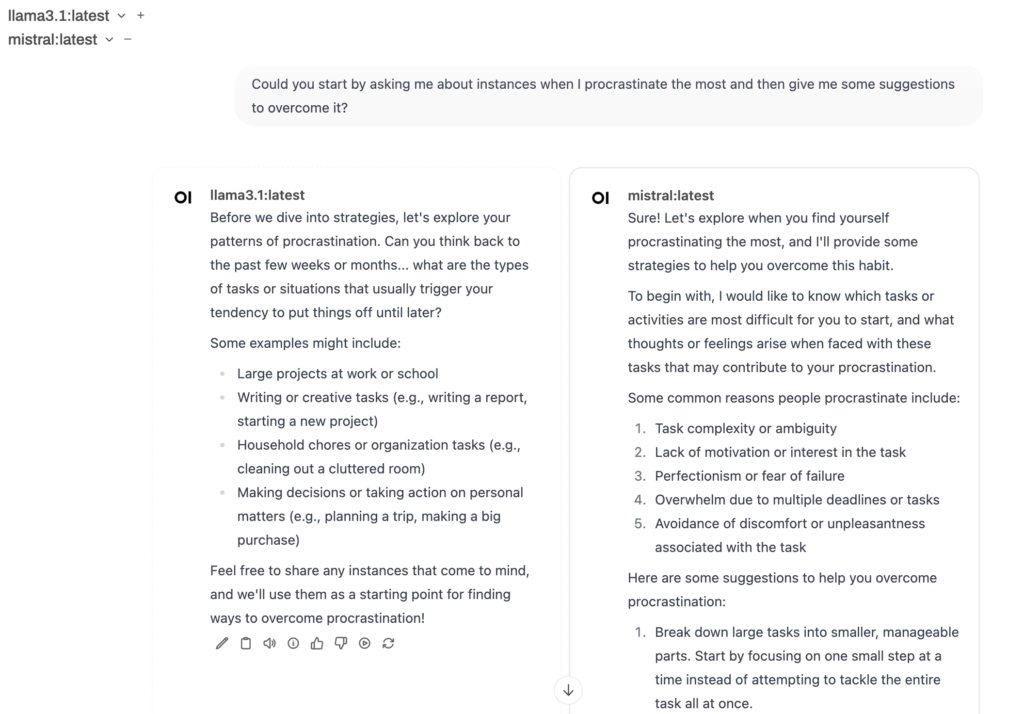

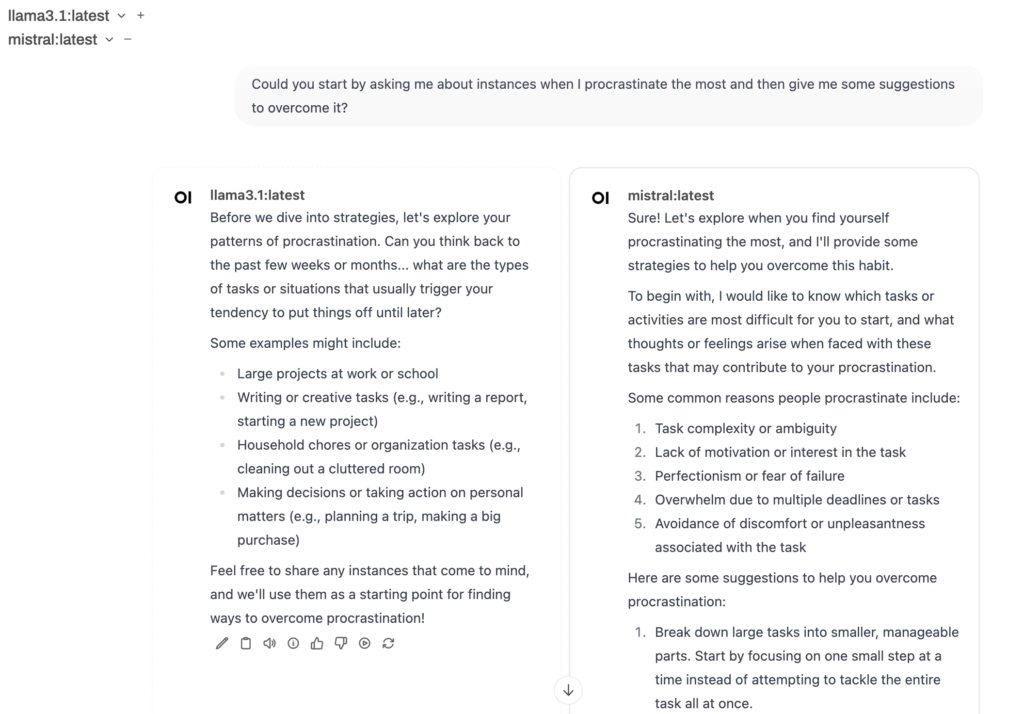

یکی دیگر از ویژگی های منحصر به فرد، توانایی بارگذاری چندین مدل به طور همزمان است که برای مقایسه پاسخ ها ایده آل است. مدل اولیه خود را انتخاب کنید، سپس روی آن کلیک کنید + دکمه کنار آن برای انتخاب مدل های اضافی. پس از وارد کردن اعلان شما، هر مدل خروجی خود را در کنار هم تولید می کند.

سفارشی کردن خروجی های مدل

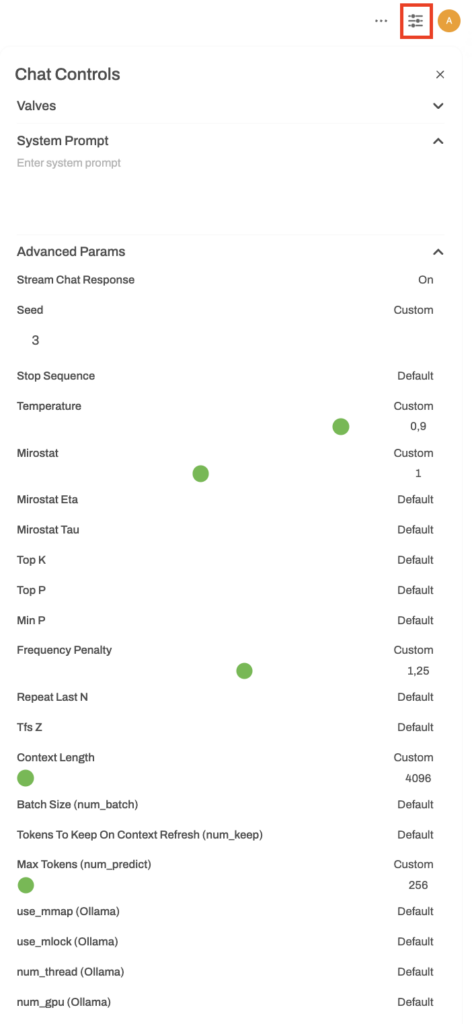

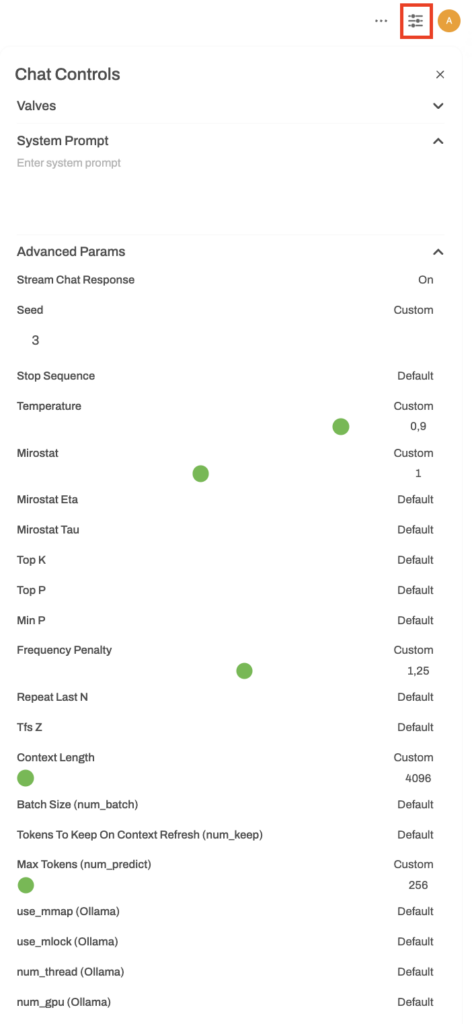

تنظیم پاسخهای مدل به شما این امکان را میدهد تا روش تفسیر اعلانها را دقیق تنظیم کنید و آن را برای وظایف، آهنگها یا نیازهای عملکردی خاص بهینه کنید. ضربه بزنید کنترل چت دکمه دسترسی به پارامترهایی که رفتار، سبک و کارایی پاسخ را تنظیم میکنند، از جمله:

- پاسخ چت جریانی. جریان پاسخ بلادرنگ را فعال میکند، جایی که مدل متن را در حالی که تولید میکند به جای انتظار برای کل خروجی نمایش میدهد.

- بذر. با ایجاد پاسخ یکسان در هر بار برای درخواستهای یکسان، نتایج یکسانی را تضمین میکند که برای آزمایش و مقایسه تنظیمات مفید است.

- توالی توقف. کلمات یا عبارات خاصی را تنظیم می کند که پاسخ را در یک نقطه طبیعی پایان می دهد، مانند پایان یک جمله یا بخش.

- دما. خلاقیت پاسخگویی را کنترل می کند. مقادیر کمتر پاسخ ها را متمرکزتر و قابل پیش بینی تر می کند، در حالی که مقادیر بالاتر خلاقیت و تنوع را افزایش می دهد.

- Mirostat. جریان پاسخ را متعادل میکند و به مدل کمک میکند در طول خروجیهای طولانیتر، به ویژه برای درخواستهای دقیق، منسجم بماند.

- جریمه فرکانس. تکرار کلمات را کاهش می دهد و انتخاب کلمات متنوع تر را تشویق می کند.

- طول زمینه. مقدار اطلاعاتی را که مدل در هر پاسخ به خاطر می آورد را برای جریان گفتگوی روان تر تنظیم می کند.

- حداکثر توکن ها (num_predict). طول پاسخ را محدود می کند، برای مختصر نگه داشتن پاسخ ها مفید است.

در همین منو می توانید سفارشی سازی کنید شیرآلات، که شامل ابزارها و توابع سفارشی و اعلان سیستم، که لحن و رفتار مدل را مشخص می کند. در ادامه این موارد را بیشتر توضیح خواهیم داد ویژگی های همکاری بخش

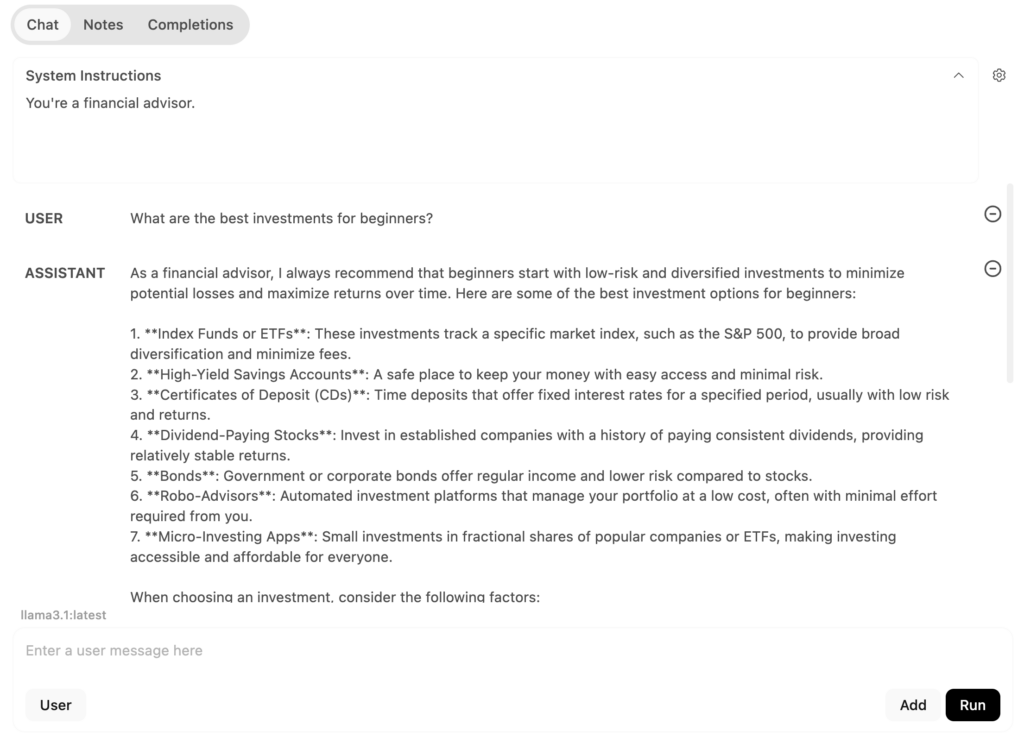

علاوه بر این، زمین بازی حالت، قابل دسترسی از گوشه سمت راست بالا، به شما امکان می دهد تنظیمات مختلف و انواع درخواست را آزمایش کنید. در چت کنید تب، میتوانید تنظیمات مکالمه را آزمایش کنید:

- دستورالعمل های سیستم. نقش مدل را تعریف کنید یا دستورالعمل های خاصی را برای رفتار آن تنظیم کنید.

- پیام کاربر. سوالات یا دستورات را مستقیماً برای مدل وارد کنید.

به عنوان مثال، تنظیم دستورالعملهای سیستم روی «شما یک مشاور مالی هستید» و تایپ یک سؤال در قسمت کاربر، مدل را وادار میکند تا از این منظر پاسخ دهد.

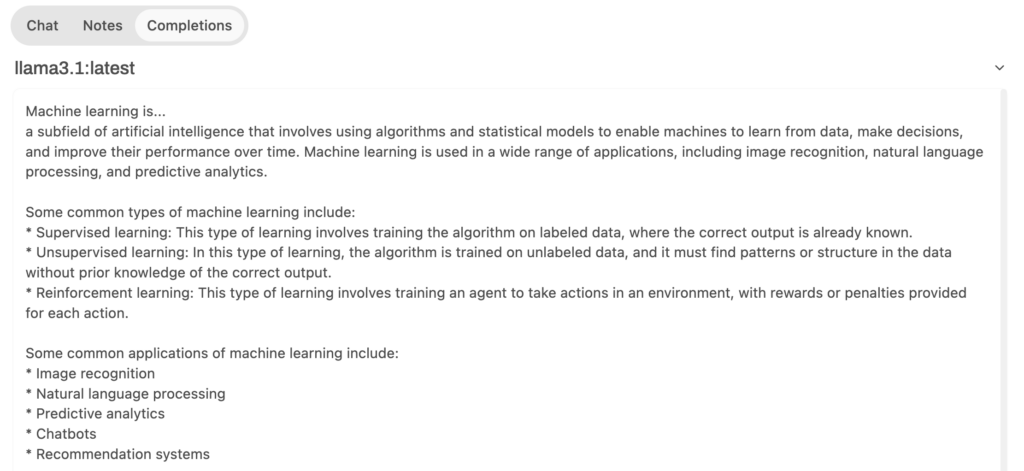

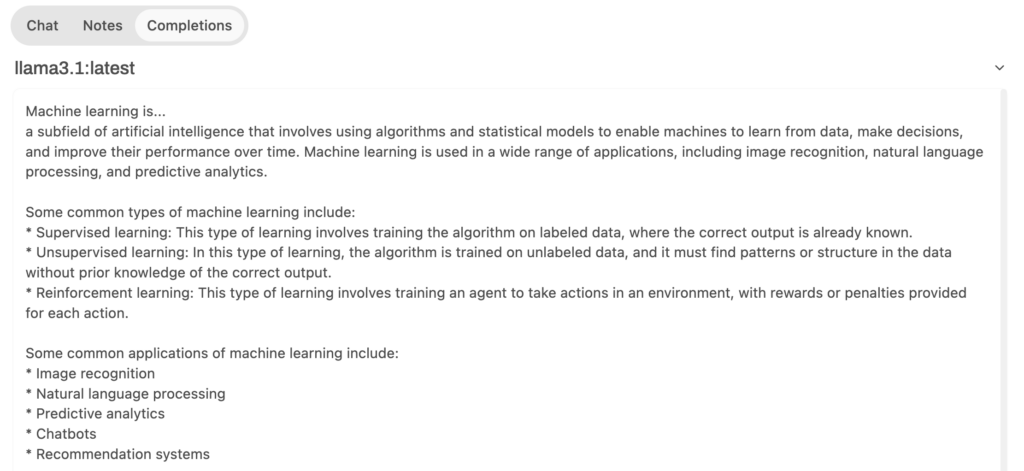

در همین حال، تکمیل تب به مدل میخواهد با ادامه دادن از ورودی شما، پاسخهایی ایجاد کند. برای مثال، اگر «یادگیری ماشینی است…» را تایپ کنید، مدل عبارت را تکمیل میکند و یادگیری ماشین را توضیح میدهد.

دسترسی به اسناد و صفحات وب

Ollama و Open WebUI از نسل افزوده بازیابی (RAG) پشتیبانی میکنند، ویژگی که پاسخهای مدل هوش مصنوعی را با جمعآوری اطلاعات بلادرنگ از منابع خارجی مانند اسناد یا صفحات وب بهبود میبخشد.

با انجام این کار، مدل میتواند برای پاسخهای دقیقتر به اطلاعات بهروز و مربوط به زمینه دسترسی پیدا کند.

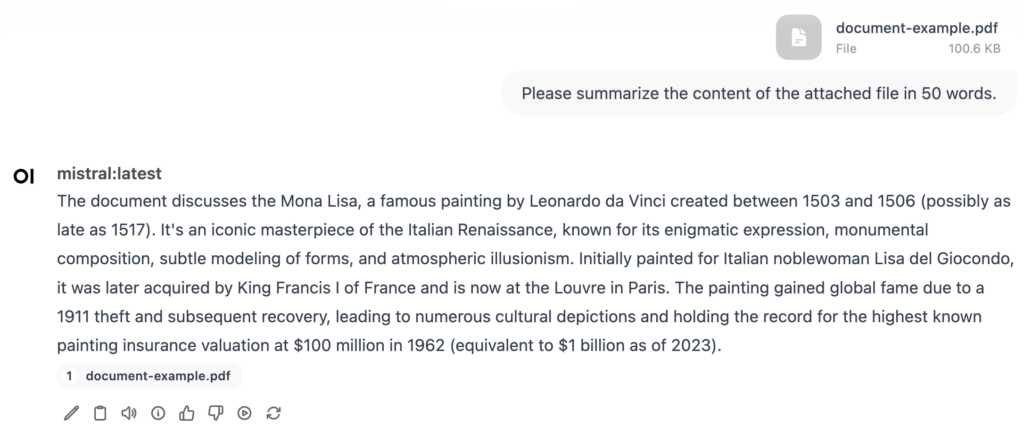

Open WebUI به شما امکان می دهد اسناد را در داخل آپلود کنید DOC، PDF، TXT، و RTF فرمت ها را کلیک کنید + را در قسمت درخواست فشار دهید و انتخاب کنید آپلود فایل ها. سندی را که می خواهید آپلود کنید انتخاب کنید، سپس یک دستورالعمل برای مدل تایپ کنید، مانند:

لطفاً محتوای فایل پیوست را در 50 کلمه خلاصه کنید.

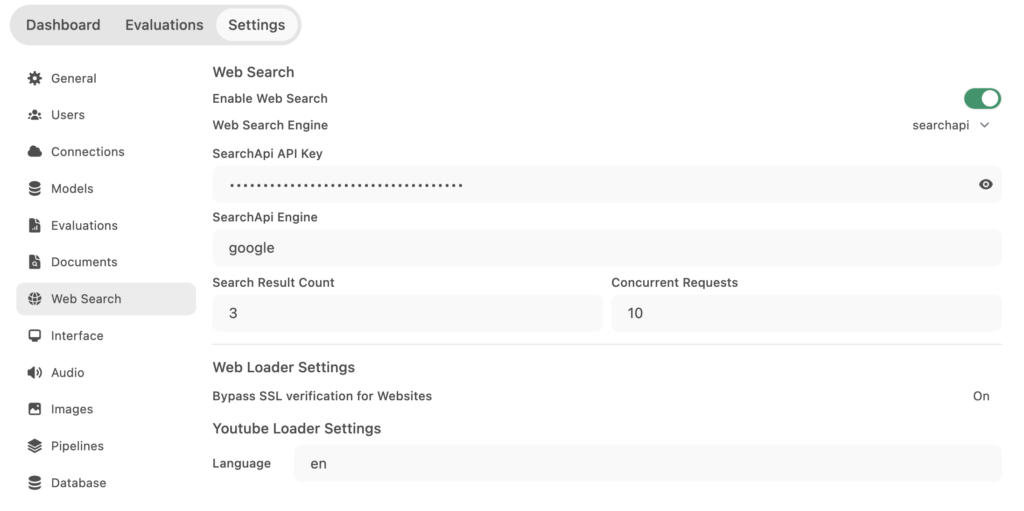

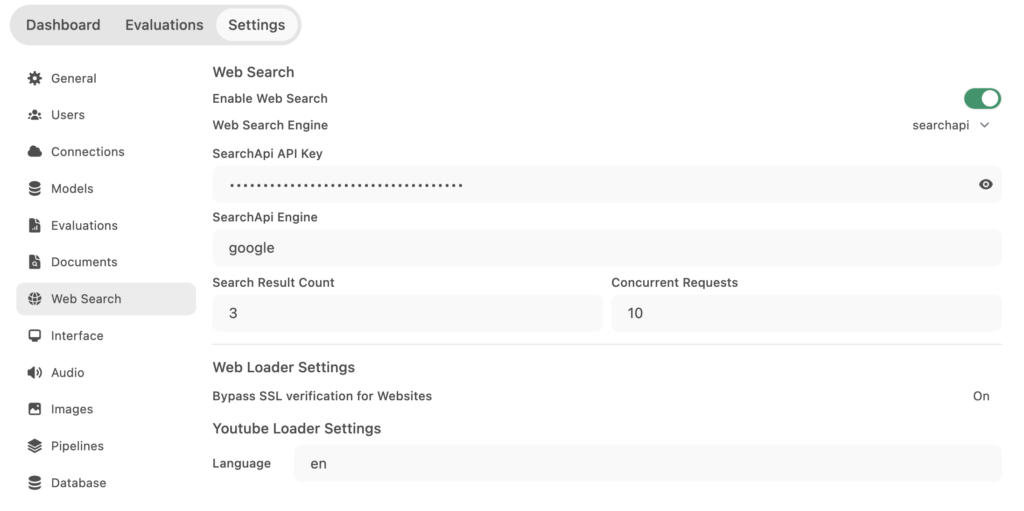

اگر میخواهید مدل وب را مرور کند، میتوانید Open WebUI را به SearchApi متصل کنید، یک رابط برنامهنویسی کاربردی (API) که اطلاعات را بر اساس بازیابی میکند. روی نتایج جستجو برای تنظیم آن مراحل زیر را دنبال کنید:

- برو به سایت رسمی SearchAPI و برای یک حساب کاربری جدید ثبت نام کنید.

- در داشبورد، کلید API خود را کپی کنید.

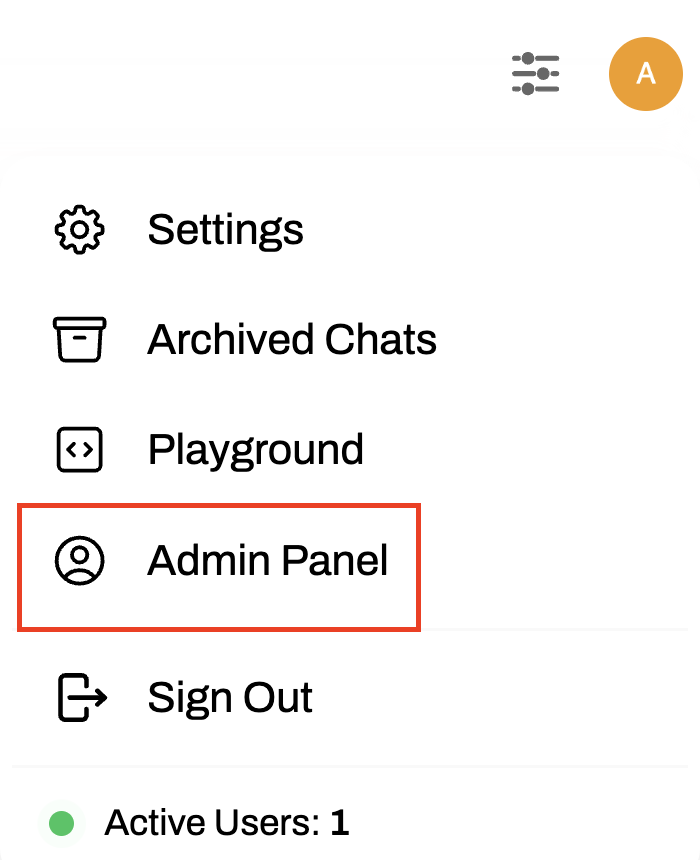

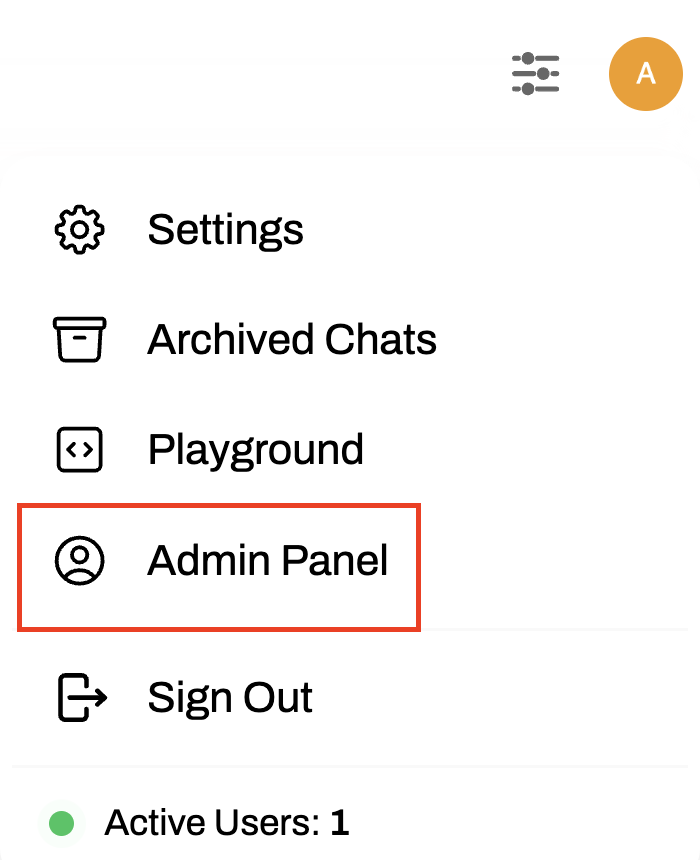

- به Open WebUI برگردید، سپس به نمایه شما → پنل مدیریت.

- حرکت به تنظیمات → جستجوی وب.

- تغییر وضعیت دهید جستجوی وب را فعال کنید برای فعال کردن ویژگی

- در موتور جستجوی وب، انتخاب کنید جستجوپی از لیست کشویی

- کلید API را که قبلاً کپی کردهاید جایگذاری کنید.

- موتور جستجوی دلخواه خود را وارد کنید، مانند گوگل، بینگ، یا بایدو. اگر خالی بماند، SearchApi به طور پیشفرض روی آن تنظیم میشود گوگل.

- کلیک کنید ذخیره کنید.

پس از راه اندازی process کامل است، به رابط چت برگردید، روی آن کلیک کنید + را در قسمت پیام فشار دهید و فعال کنید جستجوی وب. اکنون می توانید از مدل بخواهید که مستقیماً از وب به اطلاعات دسترسی داشته باشد. به عنوان مثال:

«آخرین اخبار را بیابید روی انرژی های تجدیدپذیر و نکات مهم را خلاصه کنید.

استفاده از ویژگی های همکاری

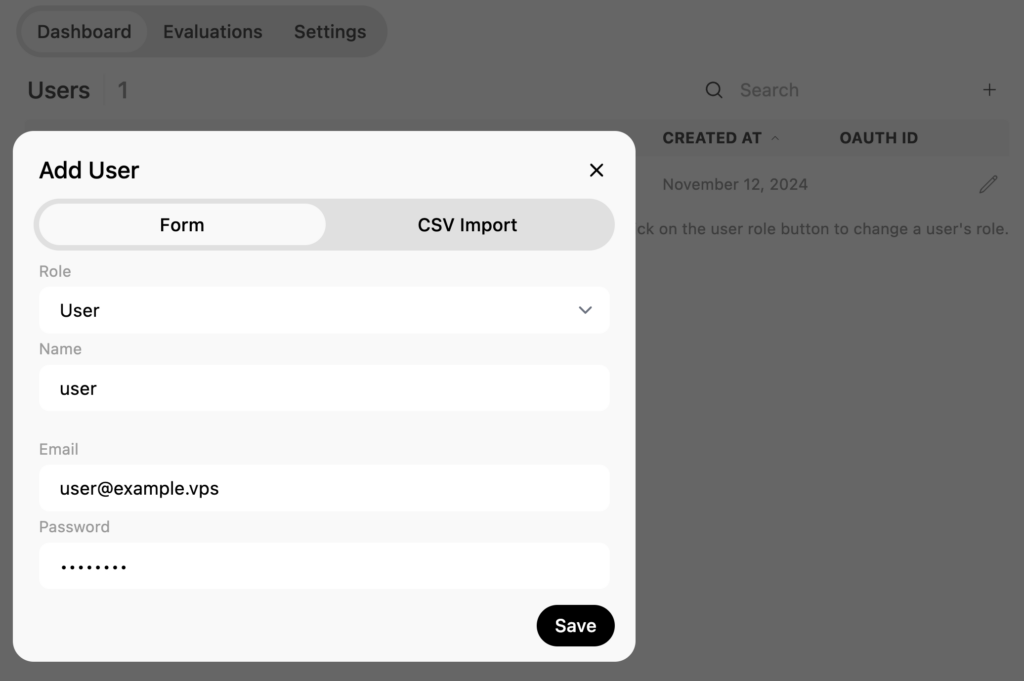

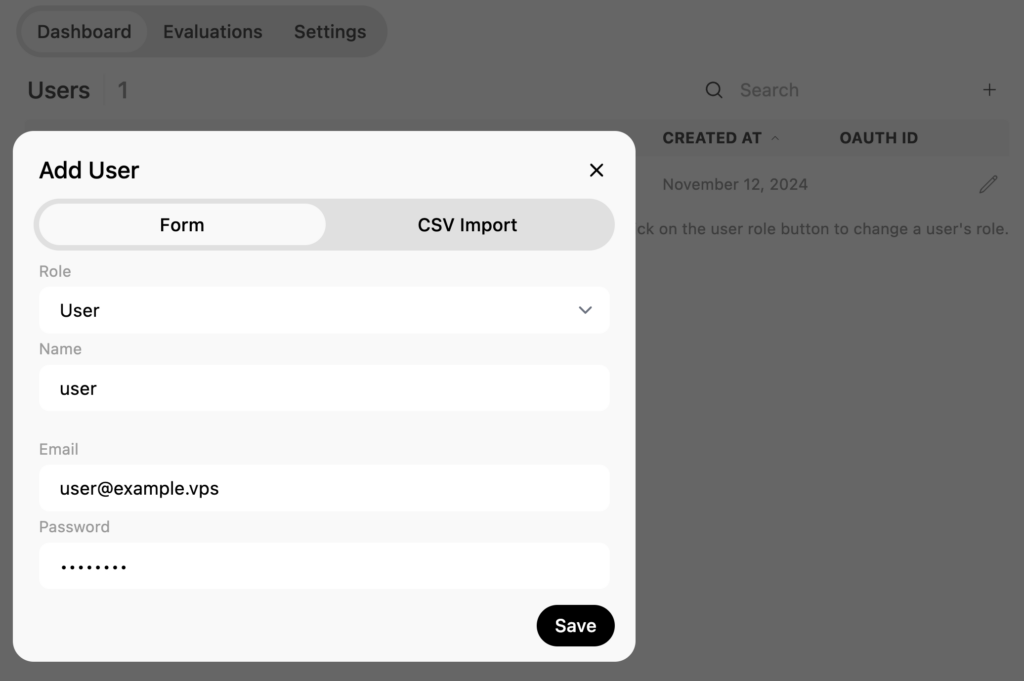

برای تیم هایی که به دنبال همکاری هستند، Open WebUI به شما امکان می دهد چندین کاربر را مدیریت کنید. برای افزودن کاربر جدید:

- رفتن به پنل مدیریت → داشبورد → افزودن کاربر.

- نقش کاربر جدید را وارد کنید کاربر یا مدیر – به همراه نام، آدرس ایمیل و رمز عبور آنها.

پس از تکمیل، اعتبارنامه را با کاربر به اشتراک بگذارید تا بتواند وارد شود. لطفاً توجه داشته باشید که کاربران غیر سرپرست نمی توانند به قسمت فضای کاری و پنل مدیریت دسترسی داشته باشند.

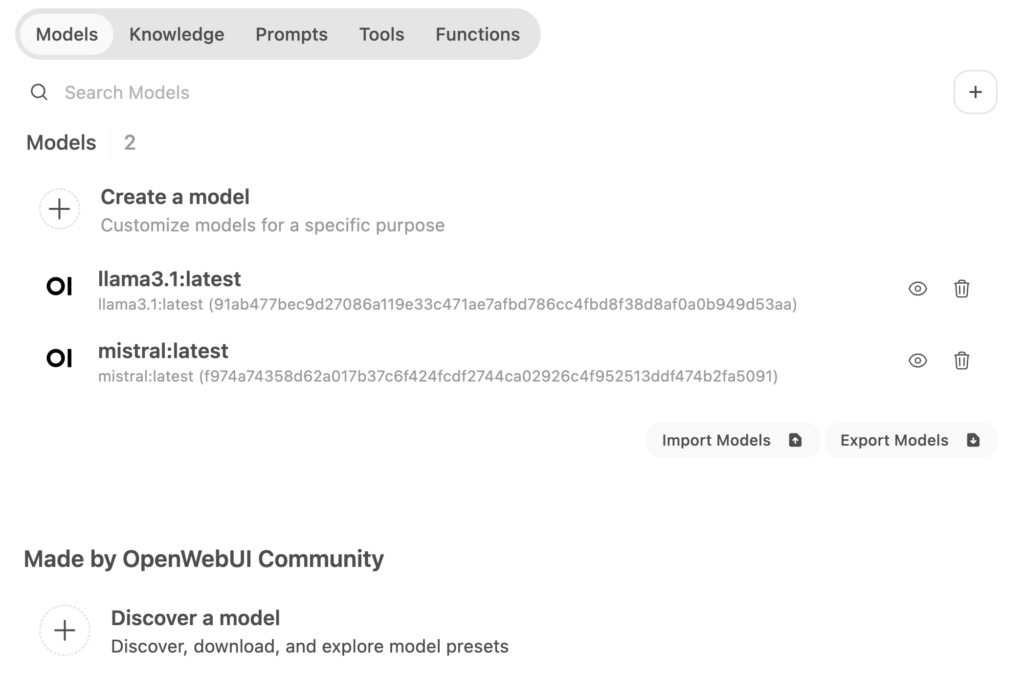

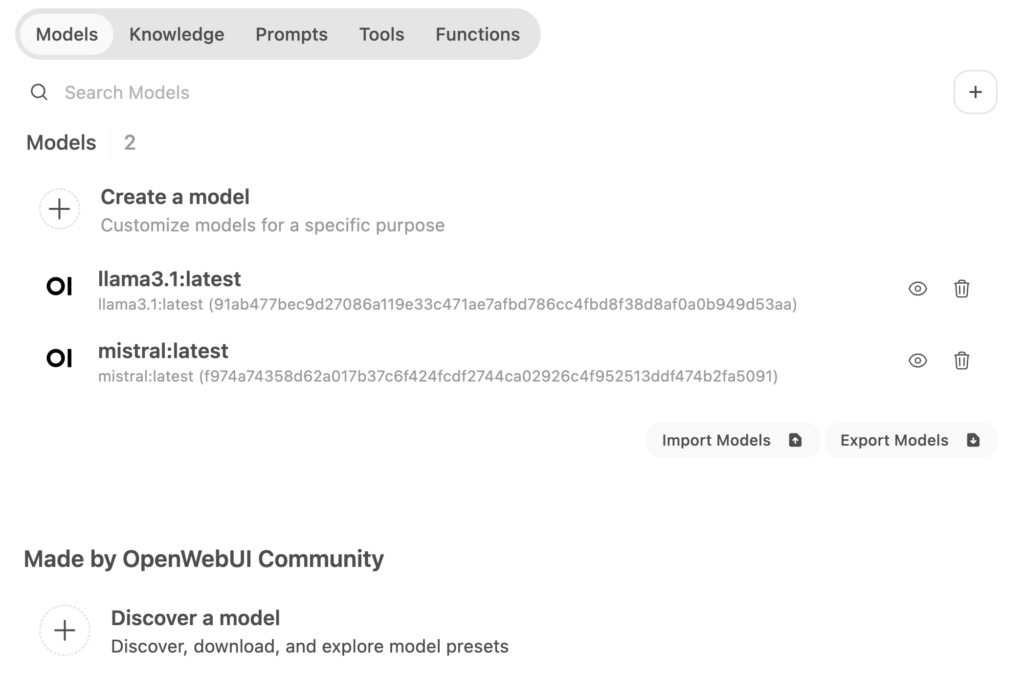

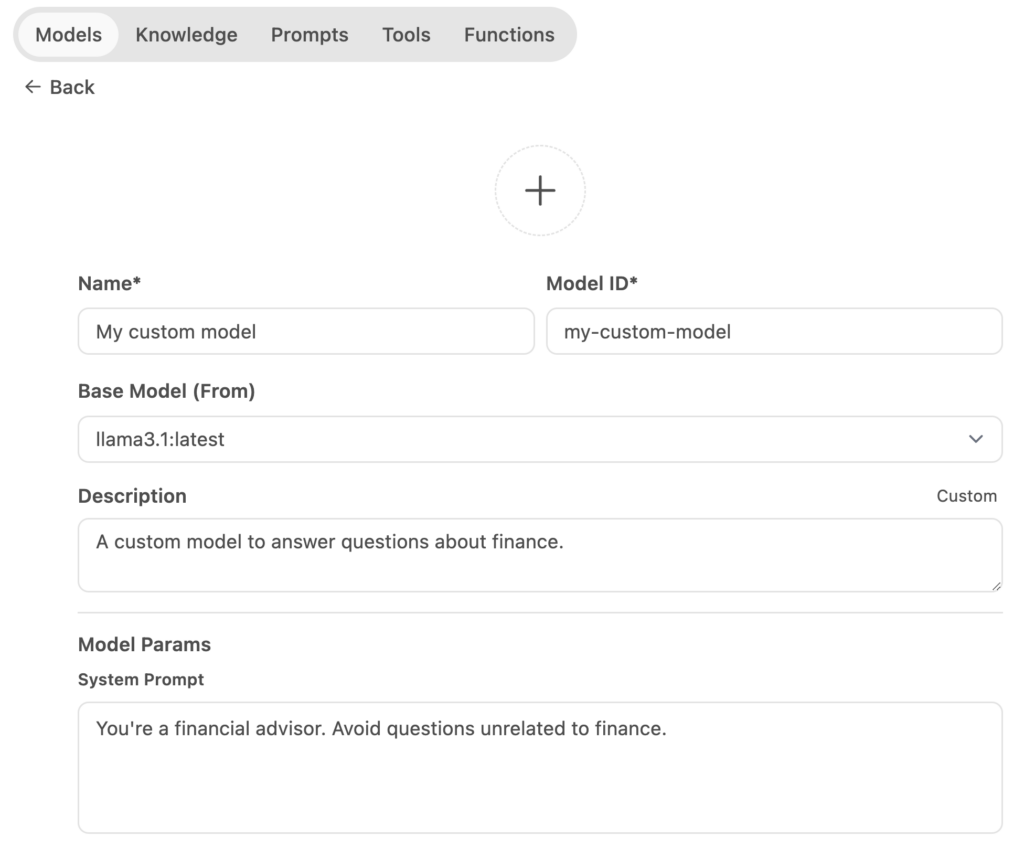

سپس، از طریق نوار کناری سمت چپ، منطقه فضای کاری را کاوش کنید. در مدل ها تب، شما می توانید بر اساس مدل های جدید ایجاد کنید روی موجود، import مدلهای سفارشی را از انجمن WebUI باز کنید و مدلهای دانلود شده را حذف کنید.

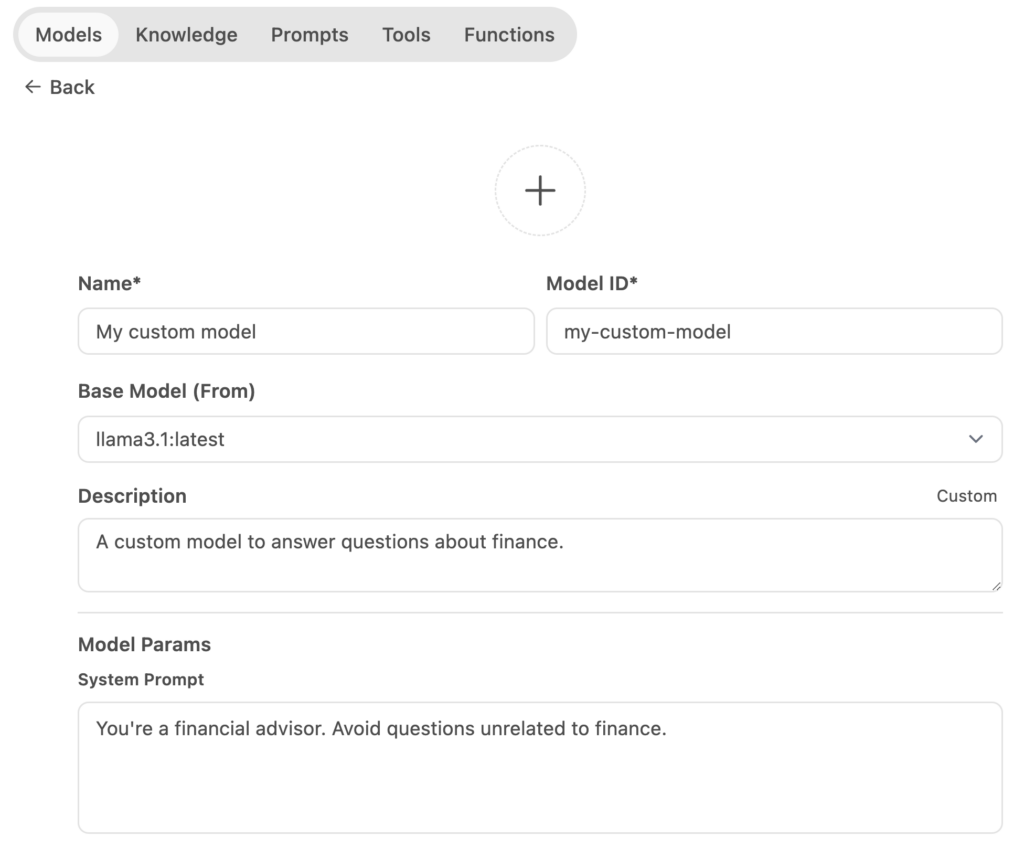

برای ایجاد یک مدل سفارشی، کلیک کنید یک مدل ایجاد کنید و مشخصاتی مانند نام، شناسه و مدل پایه را پر کنید. همچنین میتوانید یک سیستم سفارشی برای هدایت رفتار مدل اضافه کنید، مثلاً به آن دستور دهید مانند یک مشاور مالی عمل کند و از سؤالات نامرتبط اجتناب کند.

گزینه های پیشرفته نیز برای تنظیم پارامترها، افزودن پیشنهادات سریع و import منابع دانش پس از اتمام تنظیمات، کلیک کنید ذخیره و ایجاد کنید.

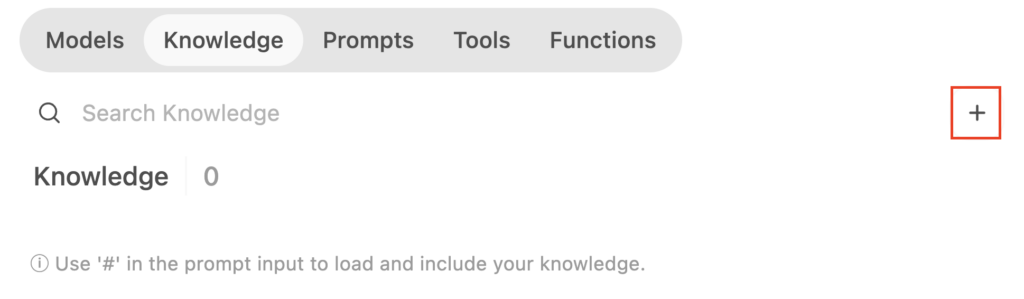

اگر هنوز منابع دانشی ایجاد نکرده اید و می خواهید مدل جدید خود را آموزش دهید، به ادامه مطلب بروید دانش برگه را کلیک کنید + را فشار دهید و دستورالعمل ها را دنبال کنید import مجموعه داده شما پس از آپلود، به مدل جدید خود بازگردید و import دانشی که به تازگی اضافه کرده اید

شما می توانید سفارشی سازی های مشابه را در درخواست ها، ابزارها، و توابع زبانه ها اگر مطمئن نیستید که چگونه شروع کنید، import در عوض از پیش تنظیم های ساخته شده توسط جامعه.

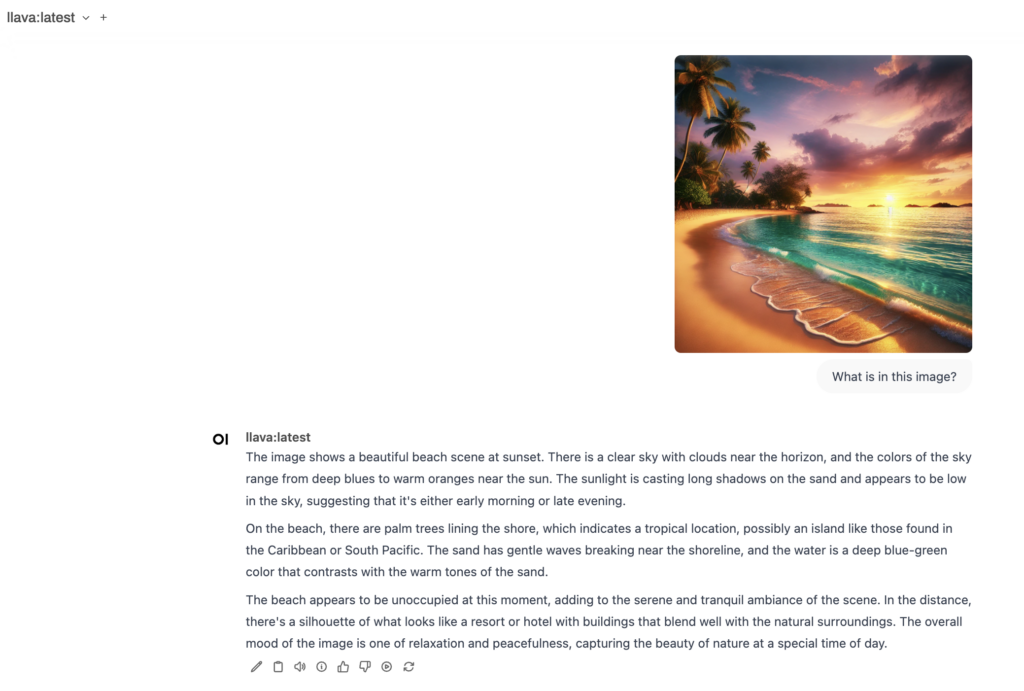

کار با مدل های چند وجهی

در نهایت، روش کار با مدلهای چندوجهی را نشان خواهیم داد که میتوانند بر اساس پاسخها تولید کنند روی متن و تصاویر Ollama از چندین مدل چند وجهی پشتیبانی می کند، از جمله LlaVa، BakLLaVA، و MiniCPM-V.

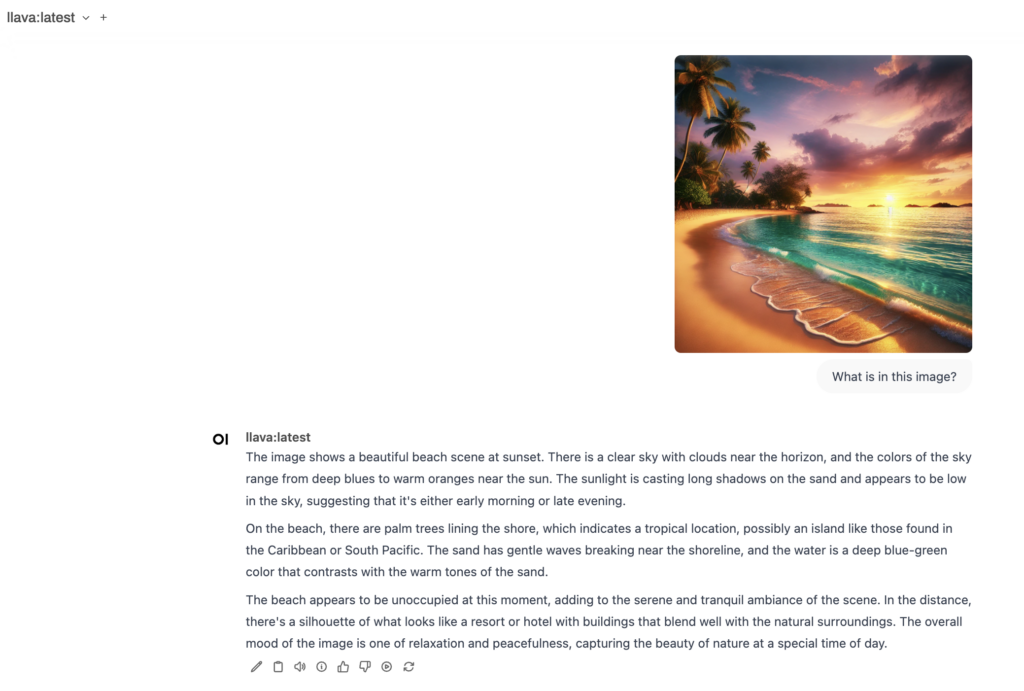

در این مثال، ما استفاده خواهیم کرد LlaVa. پس از دانلود از پنل انتخاب مدل می توانید برای کارهای مختلف از آن استفاده کنید. به عنوان مثال، می توانید یک تصویر را آپلود کنید و از مدل سؤالاتی در مورد آن بپرسید، مانند “در این تصویر چیست؟”

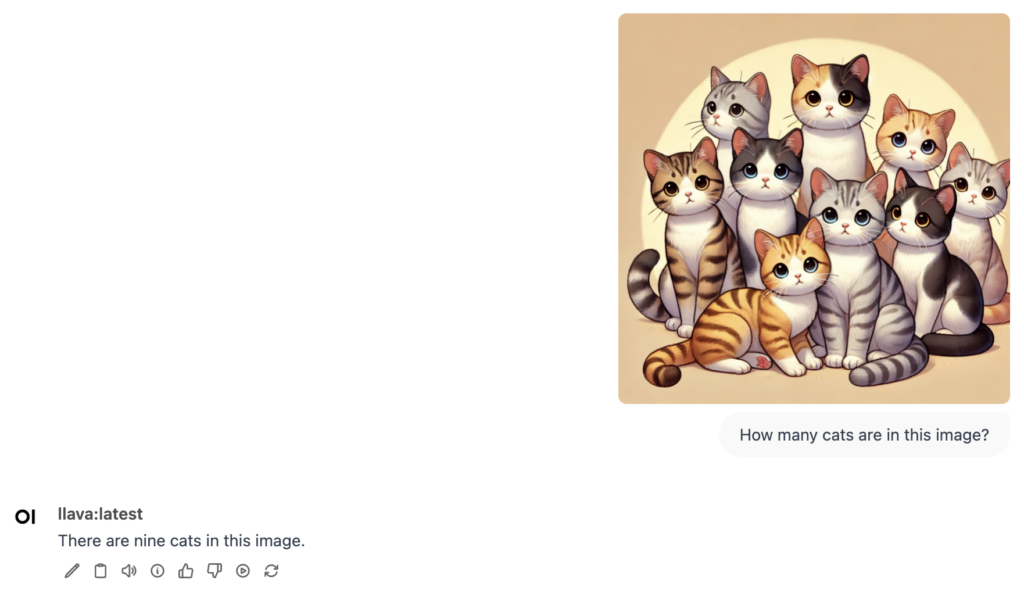

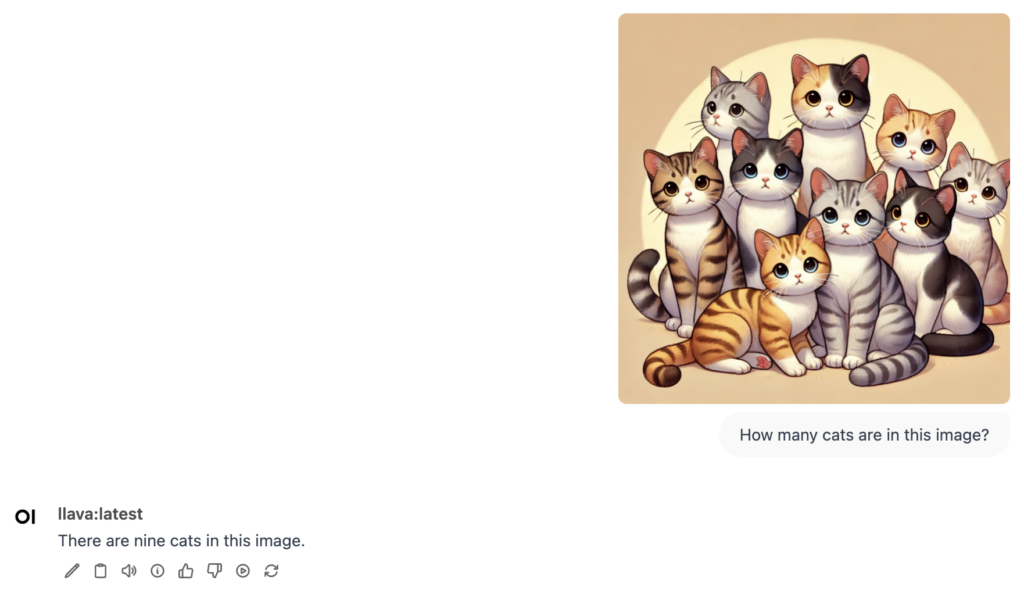

همچنین می توانید از آن برای ایجاد زیرنویس های توصیفی برای تصاویر خود استفاده کنید. علاوه بر این، مدل می تواند اشیاء درون یک تصویر را شناسایی کند. به عنوان مثال، اگر تصویری از گربه ها را آپلود کنید، ممکن است از مدل بپرسید: «در این تصویر چند گربه وجود دارد؟

با این حال، لطفاً توجه داشته باشید که LLaVA در حال حاضر نمی تواند تصاویر تولید کند. هدف اصلی آن تجزیه و تحلیل و پاسخ به سوالات مربوط به تصاویر موجود است.

نتیجه گیری

استفاده از Olama با Open WebUI به شما امکان می دهد مدل ها را از طریق یک رابط بصری و مبتدی پسند اجرا کنید. هاستینگerالگوی Ollama VPS نصب این ابزارها را حتی برای کاربران غیر فنی آسان می کند.

پس از نصب، میتوانید داشبورد را پیمایش کنید، مدلها را انتخاب و اجرا کنید، و ویژگیهای همکاری را برای افزایش بهرهوری بررسی کنید. ابزارهای پیشرفته WebUI را باز کنید – مانند جستجوی وب و سفارشی سازی پارامترهای مدل – آن را برای کاربرانی که به دنبال ایجاد تعاملات مدل هستند ایده آل می کند.

برای کسانی که علاقه مند به استقرار مدل های خود هستند، می توانید import مجموعههای دانش شما، دستورالعملهای مختلف را آزمایش کنید و آنها را با الگوها و توابع سفارشی سفارشی ساخته شده توسط انجمن ترکیب کنید.

اگر سوالی دارید، در نظرات زیر بپرسید!

استفاده از اوللاما با پرسشهای متداول رابط کاربری گرافیکی

چرا از Olama با رابط کاربری گرافیکی استفاده کنیم؟

استفاده از Ollama با ابزار رابط کاربری گرافیکی مانند Open WebUI، تعاملات مدل را از طریق یک رابط بصری ساده می کند، و آن را برای مبتدیان پسند و ایده آل برای گردش های کاری مشترک و مبتنی بر تیم بدون نیاز به کاربر می کند. command-line تخصص

از چه مدل هایی می توانم در نسخه رابط کاربری گرافیکی استفاده کنم؟

شما می توانید از همه مدل های Olama در هر دو نسخه CLI و GUI استفاده کنید. با این حال، محیط رابط کاربری گرافیکی، اجرای مدل های چندوجهی را برای کارهایی مانند تجزیه و تحلیل تصاویر راحت تر می کند.

آیا برای اجرای نسخه رابط کاربری گرافیکی Olama به Docker نیاز دارم؟

بله، قبل از راه اندازی Ollama با Open WebUI باید Docker را نصب کنید. اگر استفاده می کنید هاستینگerدر قالب اوللاما، تمام اجزای لازم، از جمله داکر، از قبل نصب شده است.

لطفا در صورت وجود مشکل در متن یا مفهوم نبودن توضیحات، از طریق دکمه گزارش نوشتار یا درج نظر روی این مطلب ما را از جزییات مشکل مشاهده شده مطلع کنید تا به آن رسیدگی کنیم

زمان انتشار: 1403-12-26 08:43:12